まず最初に:やってはいけない3つのこと

生成AIを仕事で使うなら、この3つだけは絶対に守ってください。これだけでリスクの大半を防げます。

企業の生成AI活用方針策定率は約5割(49.7%)ですが、中小企業に限ると約3割にとどまります。セキュリティを含むガイドライン整備が急務です(出典:総務省 令和7年版情報通信白書)。

| やってはいけないこと | 具体的に何がダメ? | どうなる? |

|---|---|---|

| **1. お客様の個人情報を入力する** | 氏名・電話番号・住所・メールアドレスなど | AIの学習データに取り込まれる可能性がある |

| **2. 社外秘の数字を入力する** | 見積金額・契約条件・未公開の売上データなど | 第三者の回答に反映されるリスクがある |

| **3. パスワードやログイン情報を入力する** | 社内システムのID・PW・APIキーなど | 不正アクセスの原因になりうる |

「え、それだけ?」と思った方——はい、まずはこの3つだけで十分です。 以下、なぜこれが危ないのか、そしてどうすれば安全に使えるのかを、専門用語なしでわかりやすく解説します。

情報漏洩って具体的に何が起きるの?

「情報漏洩」と聞くとハッキングのような大事件を想像するかもしれません。でも、生成AIでの情報漏洩は、もっと身近で地味な形で起きます。

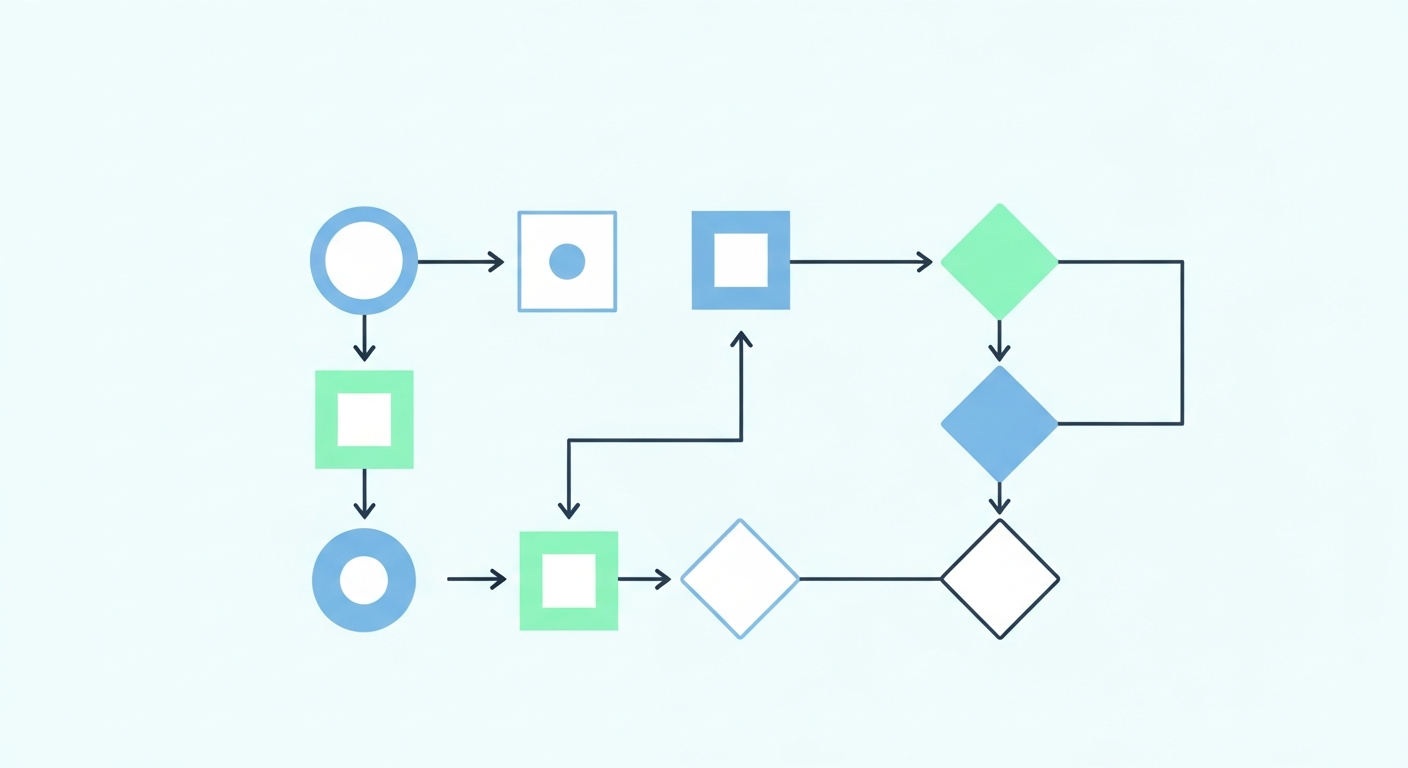

パターン1:あなたの入力内容がAIの勉強材料になる

生成AIは、ユーザーが入力した内容を「勉強材料(学習データ)」として使うことがあります。

つまりこういうことです:

- あなたが「A社との契約金額は500万円で…」と入力する

- → その情報がAIの学習に使われる可能性がある

- → 将来、別の誰かがAIに質問した時に、その情報が影響する可能性がある(直接表示される可能性は低いですが、ゼロではありません)

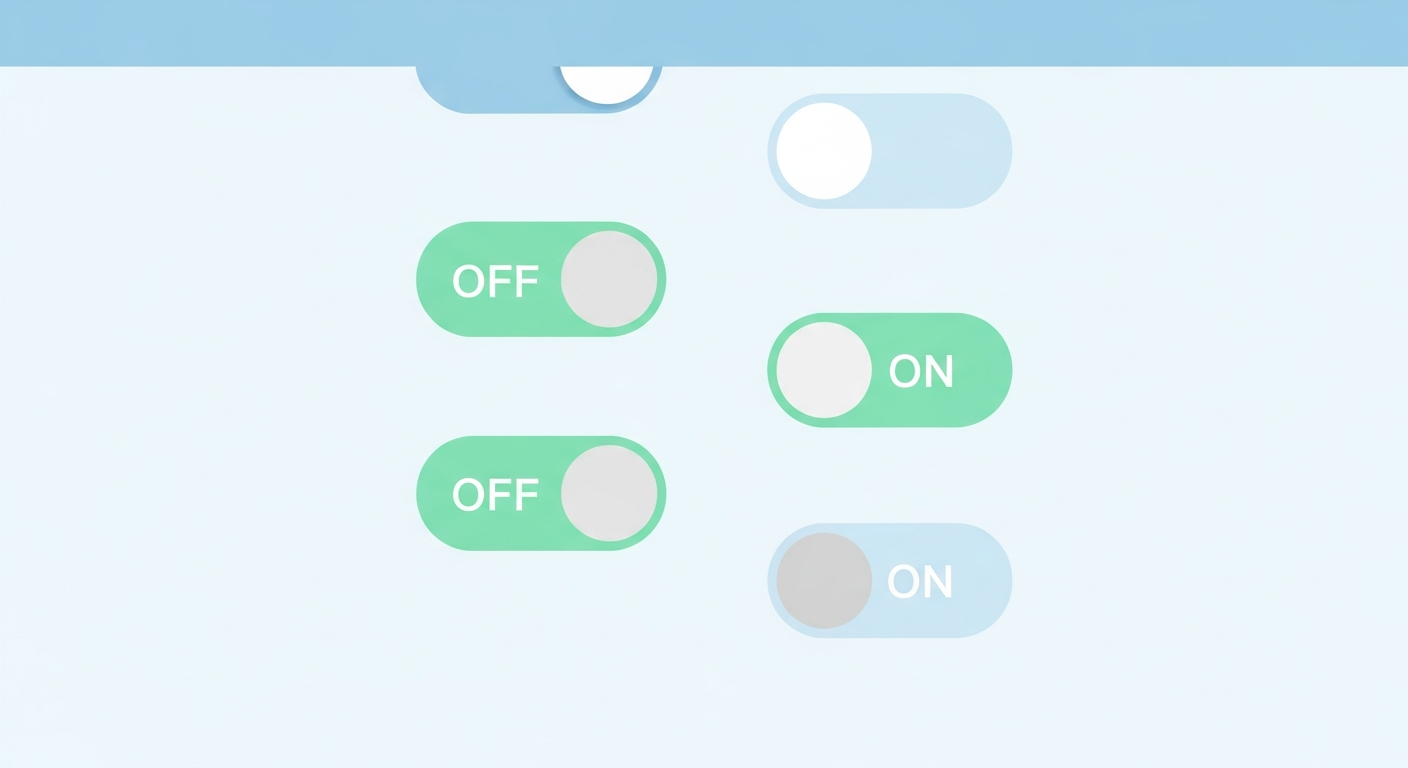

対策は簡単です: 有料プランに切り替えて「学習OFF」の設定をするだけ。具体的な手順は後述します。

パターン2:うっかり社員が入力してしまう

一番多いのがこのパターンです。「便利だから」とルールなしで使い始めると、悪気なく機密情報を入力してしまう社員が出てきます。

よくある例:

- 「このお客様へのメール文を作って」と、顧客の実名・連絡先ごと貼り付ける

- 「この見積書をチェックして」と、金額入りのPDFをアップロードする

- 「このエラーを直して」と、APIキーが含まれたコードを貼り付ける

対策: 社内で「入力OK/NGリスト」を作って共有するだけで大幅に防げます。

パターン3:アカウントの乗っ取り

AIツールのアカウントには過去の会話履歴が残っています。パスワードが弱いとアカウントを乗っ取られ、過去の会話内容が流出する可能性があります。

対策: 2段階認証(2要素認証)を設定するだけで、このリスクはほぼゼロにできます。

「安全に使うための設定手順」ツール別ガイド

ここからは、ChatGPT・Claude・Geminiそれぞれの安全設定を、画面の操作手順レベルで説明します。

ChatGPTの安全設定(所要時間:2分)

やること:入力内容がAIの学習に使われないようにする

- ChatGPTにログインする

- 画面左下の自分の名前をクリック

- 「設定」を開く

- 「データコントロール」をクリック

- 「すべての人のためにモデルを改善する」を**OFF**にする

これで、あなたが入力した内容はAIの学習に使われなくなります。

追加でやると良いこと:

- 2段階認証を有効にする(「設定」→「セキュリティ」から設定)

- 不要な過去の会話を定期的に削除する

Claudeの安全設定(所要時間:1分)

Claudeの有料版は、最初から学習OFFになっています。 追加設定は基本的に不要です。

確認方法:

- Claudeにログインする

- 画面左下のアイコンをクリック

- 「設定」を開く

- プライバシー設定を確認(有料版は学習利用がデフォルトOFF)

追加でやると良いこと:

- 2段階認証を有効にする

- 無料版を使っている場合は、有料版への切り替えを検討する

Geminiの安全設定(所要時間:3分)

- gemini.google.comにログイン

- 左メニューの「アクティビティ」をクリック

- 「Geminiアプリ アクティビティ」を**OFF**にする

これで、会話内容がGoogleの学習データとして使われなくなります。

Google Workspaceユーザーの場合:

- 管理コンソールからチーム全体のAI設定を一括管理できます

- 「管理コンソール」→「アプリ」→「Google Workspace」→「Gemini」から設定

入力OK/NGリスト:これだけ守れば大丈夫

社内で共有するための「入力していいもの・ダメなもの」リストです。このままコピーして使ってください。

入力NG(絶対に入力しない)

| カテゴリ | 具体例 |

|---|---|

| 個人情報 | お客様の氏名・住所・電話番号・メールアドレス |

| 契約・取引情報 | 契約金額・見積金額・未公開の取引条件 |

| 財務情報 | 未公開の売上・利益・給与額 |

| 認証情報 | パスワード・APIキー・アクセストークン |

| 他社の機密 | 取引先からNDAで受け取った情報 |

| 知的財産 | 特許出願前の技術・未発表の製品情報 |

入力OK(安心して使える)

| カテゴリ | 具体例 |

|---|---|

| メール文の下書き | 固有名詞は「A社」「担当者様」に置き換えてから |

| アイデア出し | 「○○業界の営業トークを考えて」など一般的な依頼 |

| 公開情報の要約 | Webで公開されている記事やニュースの整理 |

| 文章の校正 | 社内メールの文法チェック(機密部分を削除して) |

| 学習・調べもの | 業界知識・法律の概要・ビジネスマナーなど |

コツ:「固有名詞を消してから入力する」クセをつけるだけで、リスクは激減します。

「山田太郎様」→「お客様」、「株式会社ABC」→「A社」に書き換えてからAIに入力する。AIの出力結果に、後から正しい名前を書き足す。これだけです。

社内ガイドラインテンプレート

以下をそのままコピーして、自社のルールとして使えます。

【社内AI利用ガイドライン】

■ 基本方針

生成AIは業務効率化のために活用する。ただし、情報漏洩リスクを

防ぐため、以下のルールを全社員が守ること。

■ 利用可能な業務

・メール文の下書き作成(固有名詞は後から追加)

・アイデア出し・ブレインストーミング

・公開情報のリサーチ・要約

・文章の校正・翻訳

・議事録の構造化(個人情報を削除してから)

■ 入力禁止事項

・顧客の個人情報(氏名・連絡先・住所)

・契約金額・見積金額

・未公開の財務データ

・パスワード・APIキー

・取引先から秘密保持義務のある情報

■ 必須設定

・有料プランを使用すること

・「学習OFF」設定を有効にすること

・2段階認証を設定すること

■ 事故が起きたら

・誤って禁止情報を入力した場合は、すぐに会話を削除し、

上長とIT担当者に報告すること

・隠さない。早く報告するほど被害は小さくなる

■ 更新日:____年____月____日

■ 管理者:______________よくある質問と誤解

「無料版は危険、有料版は安全」は本当?

半分本当で半分誤解です。

| 比較ポイント | 無料版 | 有料版 |

|---|---|---|

| 学習にデータが使われる? | ツールによってはYES | 設定でOFFにできる |

| 回答の品質 | 同等 | 同等(利用制限が緩い) |

| 管理者機能 | なし | チームプランであり |

| サポート | なし | あり |

有料版にすべき一番の理由は「学習OFFの設定ができる」ことです。逆に言えば、個人的な調べものや学習目的なら、無料版でも問題ありません。

「AIに入力した情報がそのまま他人に表示される」は本当?

これは誤解に近いです。入力した文章がそのまま別のユーザーに表示されることは、通常のサービス動作では起きません。ただし、学習データに取り込まれた場合、回答の傾向に影響を与える可能性はゼロではありません。だからこそ「学習OFF」設定が重要です。

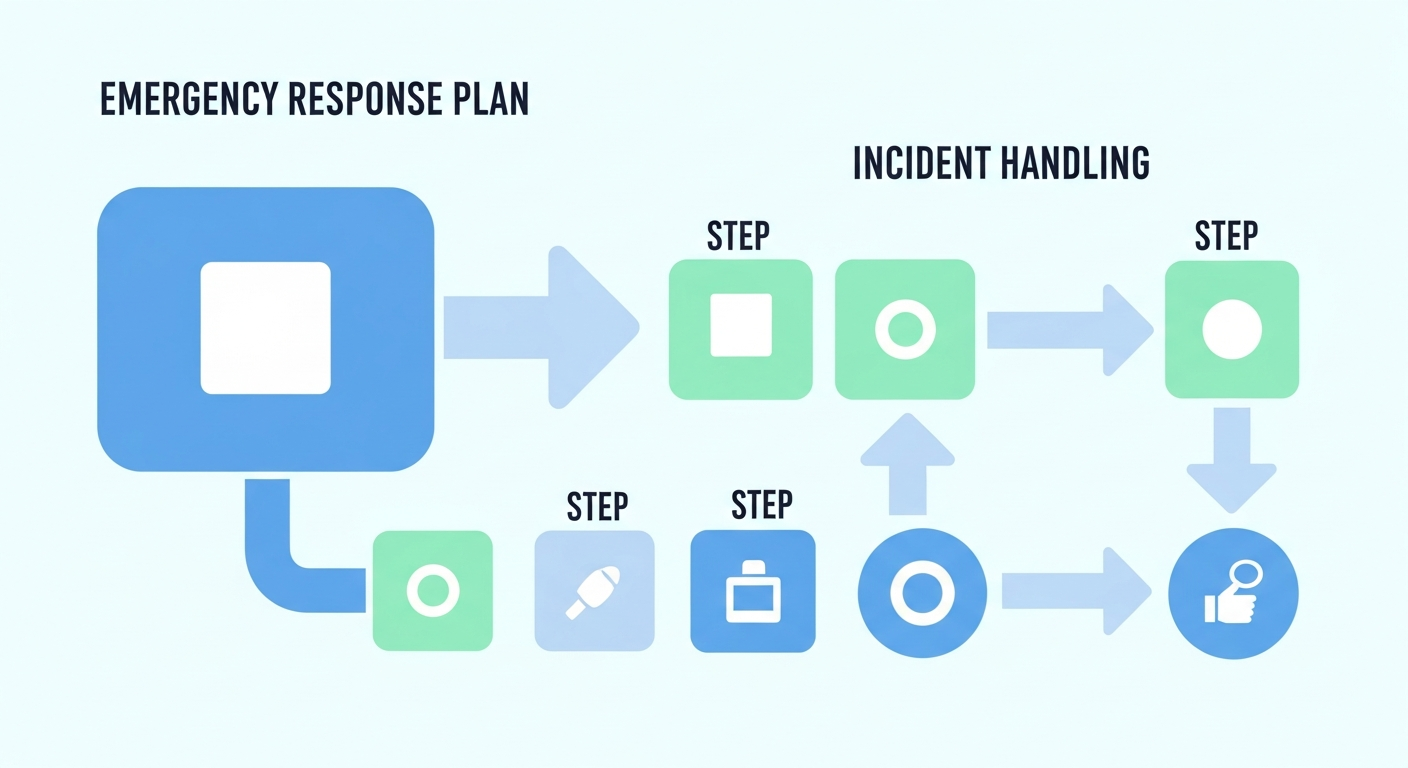

万が一の時の対応手順

禁止情報をうっかり入力してしまった場合は、以下の手順で対応してください。

ステップ1:会話を削除する(1分以内)

→ ChatGPT・Claude・Geminiすべてに「会話削除」機能があります

ステップ2:上長・IT担当者に報告する(すぐに)

→ 隠さないこと。早いほど被害は小さくなります

ステップ3:何を入力したか記録する

→ どの情報を、いつ、どのツールに入力したかをメモする

ステップ4:影響範囲を確認する

→ 顧客情報なら顧客への通知が必要か検討する

ステップ5:再発防止策を決める

→ なぜ入力してしまったか振り返り、ルールを見直す

まとめ

- **「やってはいけない3つ」を守るだけで、リスクの大半は防げる**(個人情報・機密数字・パスワードを入力しない)

- **有料プランにして「学習OFF」設定をする**のが最優先の対策

- **固有名詞を消してから入力するクセ**をつけるだけで安全性が大幅アップ

- **社内ガイドラインを1枚作って共有する**だけで、うっかり事故を防げる

- **2段階認証は必ず設定する**(無料・2分で完了)

生成AIは「怖いから使わない」では、競合に差をつけられます。正しく怖がって、正しく使う。この記事のルールを守れば、安心して業務に活用できます。

FAQ

無料プランのままでも最低限の安全対策はできますか?

はい、できます。ChatGPTの場合は「設定」→「データコントロール」で学習利用をOFFにできます。Geminiは「アクティビティ」設定でOFFに。ただし、業務で日常的に使う場合は有料プランへの切り替えを推奨します。無料版でも「個人情報を入力しない」「2段階認証を設定する」の2点は必ず実施してください。

社員がルールを守らずにAIを使ってしまったらどうすればいいですか?

まずは該当の会話を削除し、入力した情報の種類を確認してください。顧客の個人情報を入力した場合は、個人情報保護法に基づく対応(報告・通知)が必要になる可能性があります。処罰よりも「なぜ入力してしまったか」の原因分析と、ルールの周知徹底が重要です。

AIツールの利用について社員にどう説明すればいいですか?

「AIは便利な道具だが、会社の秘密やお客様の個人情報は絶対に入力しないこと」——この1文をまず伝えてください。その上で、本記事の「入力OK/NGリスト」を印刷して配布し、15分程度のミニ研修を行うのが効果的です。難しい話は不要で、「何を入力して良くて、何がダメか」の線引きだけ共有すれば十分です。

海外のサーバーにデータが送られることは問題ありませんか?

ChatGPT・Claude・Geminiはいずれも米国のサーバーでデータを処理しています。個人情報保護法の観点では、個人情報の外国への提供には本人同意が原則必要です。ただし、業務上の一般的な文章作成(個人情報を含まない)であれば法的な問題は生じません。個人情報を含むデータを扱う場合は、入力前に匿名化するか、国内サーバーのサービスを検討してください。

情報漏洩が起きた場合の法的リスクはどの程度ですか?

個人情報保護法では、一定規模以上の個人情報漏洩は個人情報保護委員会への報告と本人への通知が義務です。違反した場合の罰則は最大1億円の罰金があります。また、NDA(秘密保持契約)違反による損害賠償請求のリスクもあります。事前にルールを整備し、事故を防ぐことが最大の防衛策です。